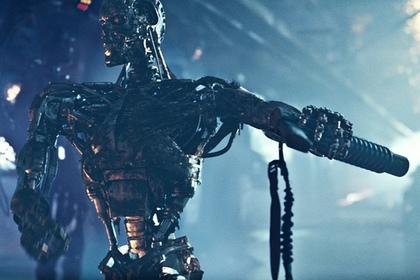

Ученые предупредили об опасности использования искусственного интеллекта (ИИ) при создании боевой техники и новейших систем вооружения. Более тысячи инженеров и исследователей подписали открытое письмо об этом. «Если какая-либо крупная военная держава стремится вперед с развитием оружия с искусственным интеллектом, то глобальная гонка вооружений практически неизбежна. Конечная точка этой технологической траектории очевидна: автономное оружие станет завтрашним "Калашниковым"», — отмечается в документе. Авторы письма призывают отказаться от использования ИИ при создании боевой техники. Они предупреждают, что гонка подобных вооружений приведет к непредсказуемым последствиям. Вопрос о создании боевых роботов уже обсуждался в ООН. Международная организация рассматривает возможность запрета определенных типов автономных боевых систем. Среди подписавших послание — известный физик и космолог Стивен Хокинг, предприниматель Элон Маск и один из основателей компании Apple Стив Возняк. Документ планируется передать делегатам международной конференции по искусственному интеллекту в Буэнос-Айресе.

Բավ է պառակտվել